오늘 추천하려고 하는 책은 혁펜하임의 <Easy! 딥러닝>이다.

딥러닝을 공부하다 보면 Loss 함수의 중요성을 깨닫는 순간이 온다. 특히, MSE(Mean Squared Error)와 BCE(Binary Cross-Entropy)의 차이는 무엇인지, 그리고 지금 내가 풀고자 하는 문제에서는 어떤 Loss 함수를 사용해야 하는지가 궁금할 때가 있다. 그래서 오늘은 딥러닝의 Loss 함수들을 MLE (Maximum Likelihood Estimation)의 관점에서 풀어낸 내용을 중심으로 리뷰를 하려고 한다.

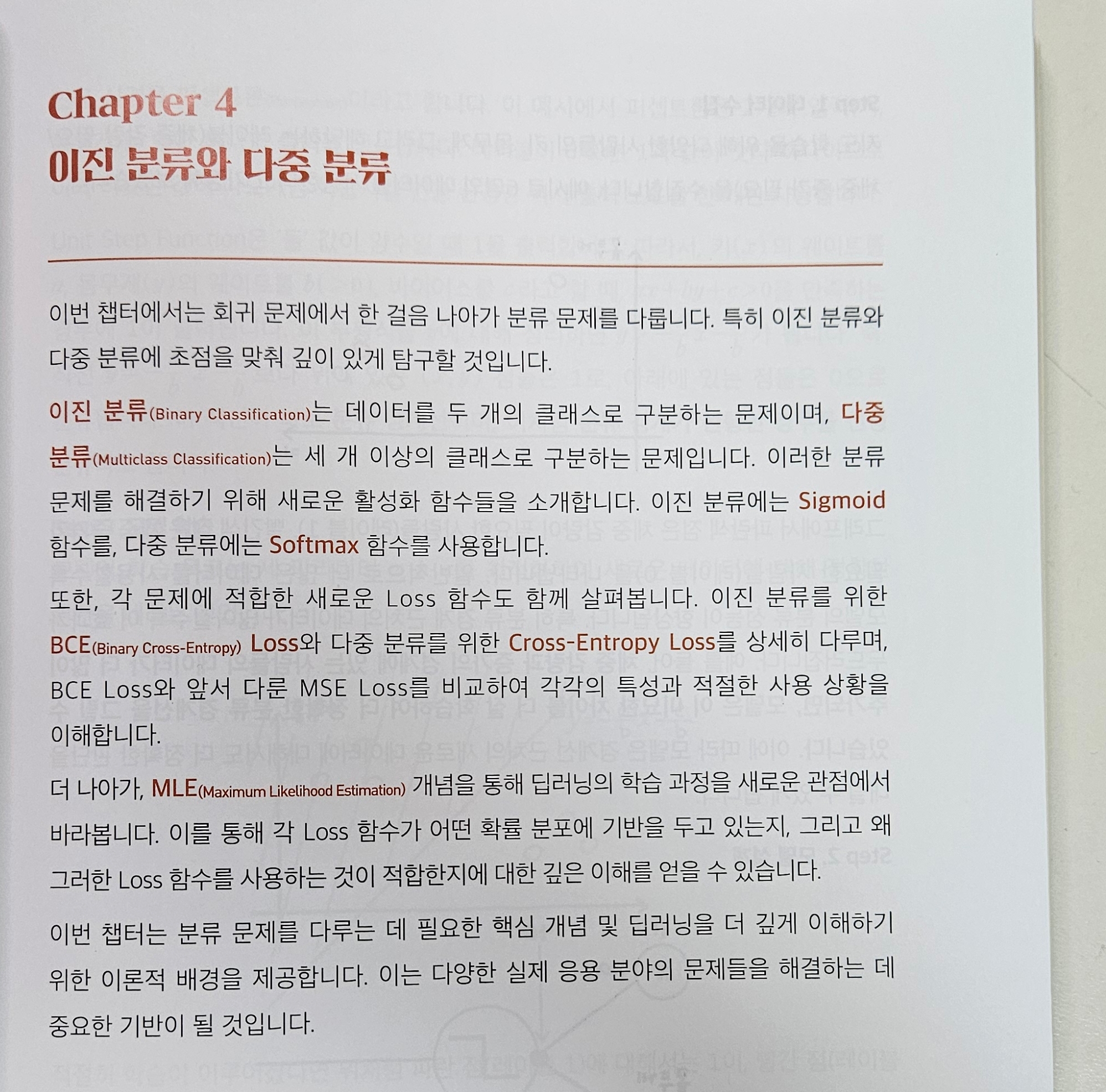

이 책의 4장에서는 MLE(Maximum Likelihood Estimation)를 기반으로 Loss 함수를 설명하며, 딥러닝 학습 과정이 확률적 추정 과정과 밀접한 관련이 있음을 보여준다.

MLE와 딥러닝의 Loss 함수

1. BCE Loss와 MSE Loss

책에서는 BCE Loss와 MSE Loss의 차이를 상세히 설명한다. MSE는 회귀 문제에서 주로 사용되며, 오차 제곱의 평균을 최소화하는 방식으로 작동한다. 반면, BCE는 이진 분류에서 사용되며, 확률 값을 직접 모델링하는 방식으로 최적화된다.

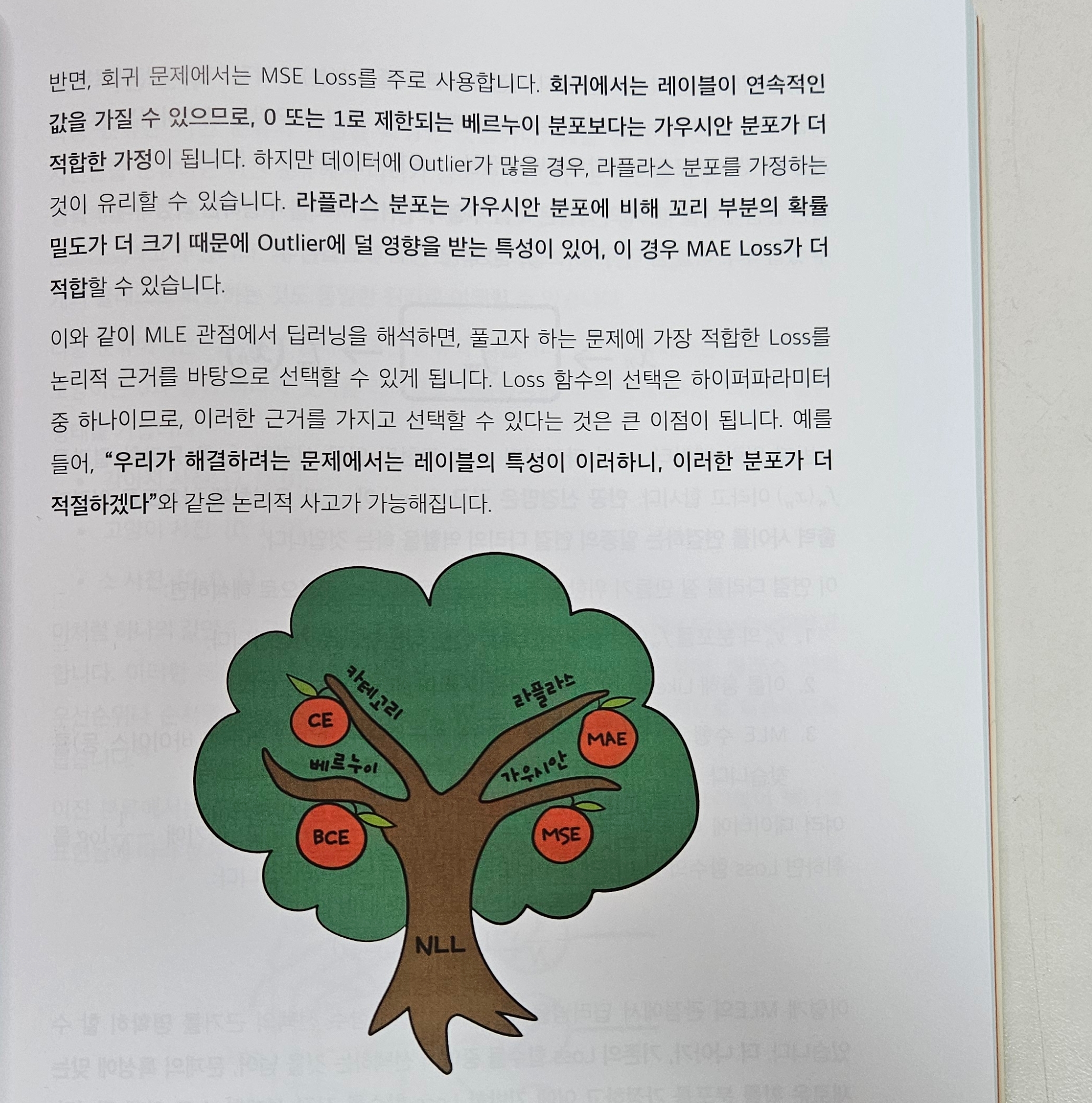

이 책에서는 BCE Loss가 사실상 MLE의 Negative Log-Likelihood(NLL)와 동일한 역할을 한다는 점을 강조한다. 즉, 모델이 특정 데이터를 보고 "이 데이터가 해당 클래스에 속할 확률을 최대로 만드는 방향으로 학습"하는 것이 MLE이며, BCE Loss는 이를 음수 로그 변환한 형태다. 반대로, MSE는 가우시안 분포를 가정한 NLL에서 유도된 Loss 함수다. 이처럼 두 Loss 함수는 서로 다른 확률 모델을 기반으로 하지만, 궁극적으로 최적의 확률을 찾는 동일한 목표를 가진다.

따라서 우리는 해결하려는 문제에 가장 잘 맞는 분포를 선택함으로써 적절한 Loss 함수를 결정할 수 있다. 이러한 관점에서 볼 때, AI의 학습은 가중치 w를 추정하기 위한 MLE를 수행하는 과정으로 볼 수 있으며, 나아가 특정 문제에 맞는 새로운 확률 분포를 가정하고 이에 기반한 Loss 함수를 설계하는 것도 가능해진다.

2. 다중 분류와 Softmax, Cross-Entropy Loss

책에서는 다중 분류 문제를 해결하는 Softmax와 Cross-Entropy Loss에 대해서도 설명한다. Softmax는 여러 개의 클래스를 확률적으로 모델링하기 위한 함수로, 모든 클래스의 확률 합이 1이 되도록 변환해준다. 이를 기반으로 Cross-Entropy Loss는 정답 클래스의 확률을 최대화하는 방향으로 작동한다.

이 과정 역시 MLE 관점에서 이해할 수 있다. Cross-Entropy Loss는 카테고리 분포를 따르는 데이터의 MLE를 수행하는 방식이며, BCE와 마찬가지로 Negative Log-Likelihood를 최소화하는 역할을 한다. 이론적으로는 BCE도 다중 분류 문제에서 사용할 수 있지만, Softmax와 함께 Cross-Entropy Loss를 사용하면 클래스 간 관계를 더 효과적으로 반영할 수 있다.

이 책은 딥러닝 입문자뿐만 아니라 기본 개념을 깊이 있게 이해하고 싶은 사람들에게 추천한다.

전체적으로 이 책에서는 복잡해 보이는 개념들을 일상적인 비유와 직관적인 설명으로 풀어내고 있다. 앞서 BCE와 MSE의 차이를 단순한 공식 비교가 아니라 MLE의 관점에서 분석한 것처럼 어려운 개념을 쉽게 설명한다. 그리고 실제 문제와의 연결을 통해 구체적인 예제와 함께 설명하여 이해를 돕는다.

추가적으로, 부록에는 딥러닝을 위한 필수 기초 수학 개념들이 정리되어 있어, 딥러닝 입문자라면 부록을 먼저 읽고 본문을 읽는 것도 좋은 방법이다. 또한 유튜브에 유튜브에 Easy! 딥러닝을 검색하면 무료 강의가 있으니 참고하면 좋을 것 같다.

딥러닝을 처음 공부하려고 하면 어떤 책을 선택할지, 어디서부터 시작해야 할지 몰라 구글링을 하다가 정보의 홍수 속에서 길을 잃기 쉽다. 그러나 작가가 말했듯이, "딥러닝을 공부하고 싶다면, 그냥 딥러닝부터 시작하세요!"라고 말하고 싶다. 기초를 익히고 이를 바탕으로 점차 심화 내용을 학습하는 과정만으로도 충분히 성장할 수 있다. 그런 면에서 이 책은 단순한 코드 구현을 넘어, 딥러닝의 이론적 배경을 탄탄하게 다지고 싶은 사람들에게 특히 추천할 만하다.

본 게시글은 혁펜하임의 <Easy! 딥러닝> 책의 리뷰어 활동으로 작성되었습니다.

- 도서 구매 링크 1 (교보문고): https://product.kyobobook.co.kr/detail/S000214848175

- 도서 구매 링크 2 (출판사 자사몰): https://shorturl.at/yqZpW

Easy! 딥러닝 | 혁펜하임 - 교보문고

Easy! 딥러닝 | 『Easy! 딥러닝』은 딥러닝을 처음 접하는 독자들을 위한 필수 가이드로, 인공지능의 기초 개념부터 CNN, RNN 등 딥러닝의 주요 주제를 폭넓게 다루고 있다. KAIST 박사이자 유튜버로 활

product.kyobobook.co.kr